Bạn đã bao giờ tự hỏi làm thế nào để các hệ thống AI có thể tương tác liền mạch với nhiều nguồn dữ liệu khác nhau? Giao thức MCP (Model Context Protocol) chính là câu trả lời cho thách thức này. Hãy cùng tìm hiểu chi tiết về công nghệ đột phá đang thay đổi cách các hệ thống AI hoạt động.

MCP là gì?

Model Context Protocol (MCP) là một giao thức chuẩn mở được Anthropic công bố vào ngày 25 tháng 10 năm 2024, nhằm kết nối các hệ thống trí tuệ nhân tạo với đa dạng nguồn dữ liệu và công cụ bên ngoài. Giao thức này được phát triển với mục tiêu giúp các mô hình ngôn ngữ lớn (LLMs) đưa ra những phản hồi chính xác, phù hợp với ngữ cảnh thực tế hơn.

MCP thường được ví như “cổng USB cho LLMs” – một giao diện phổ quát cho phép kết nối và tháo rời dễ dàng giữa các ứng dụng AI và nguồn dữ liệu. Đây là một bước tiến quan trọng trong việc giải quyết vấn đề dữ liệu bị phân mảnh trong hệ sinh thái AI hiện nay.

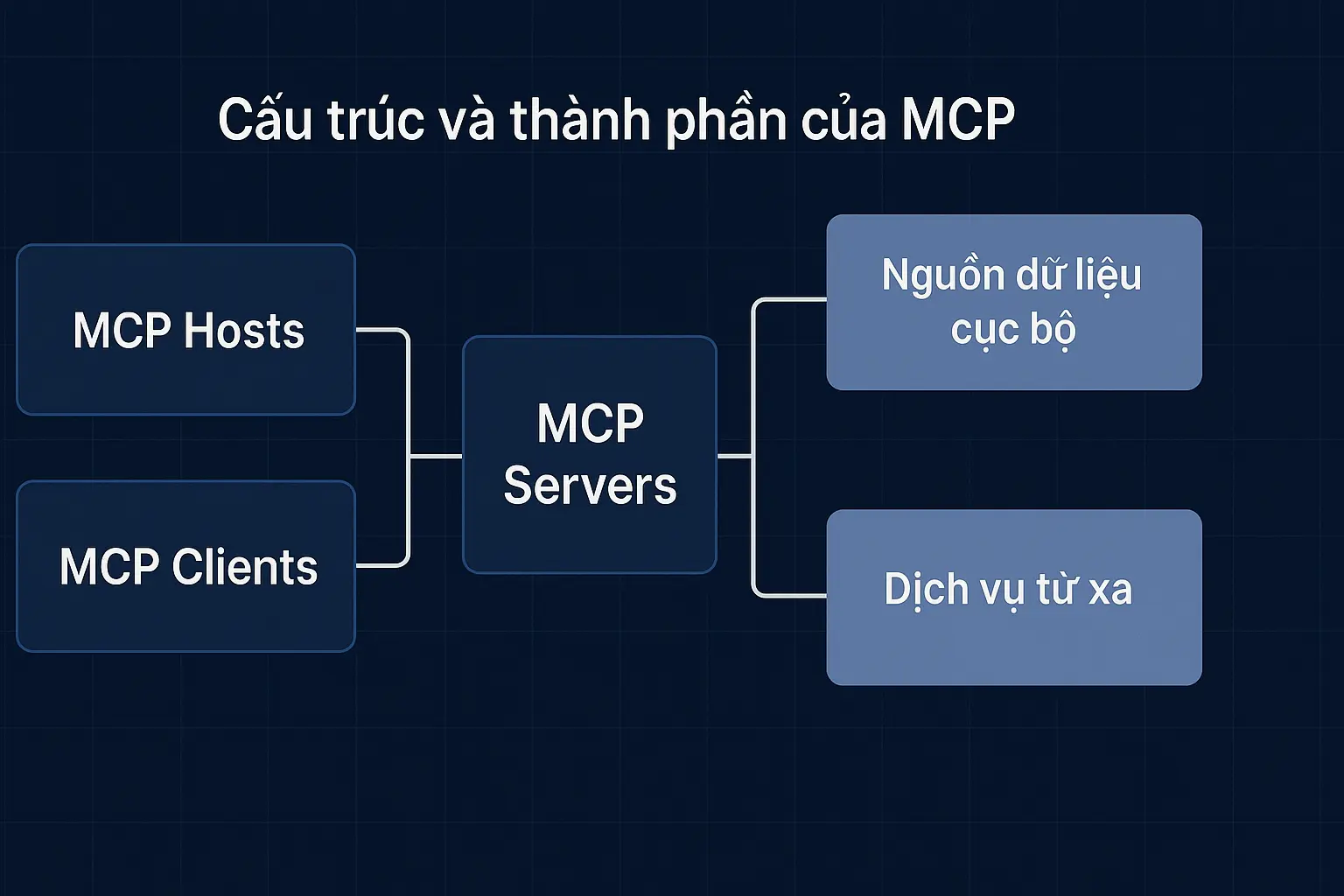

Cấu trúc và thành phần của MCP

Giao thức MCP hoạt động dựa trên kiến trúc khách-máy chủ với năm thành phần chính:

- MCP Hosts (Máy chủ lưu trữ MCP): Các ứng dụng như Claude Desktop, IDE hoặc công cụ AI muốn khai thác dữ liệu thông qua MCP.

- MCP Clients (Ứng dụng khách MCP): Các chương trình sử dụng giao thức để liên kết với MCP Server thông qua một kết nối duy nhất.

- MCP Servers (Máy chủ MCP): Những phần mềm nhỏ gọn, cung cấp các tính năng cụ thể theo chuẩn MCP.

- Nguồn dữ liệu cục bộ: Các tệp, cơ sở dữ liệu hoặc dịch vụ trên máy tính người dùng, được MCP Server truy cập an toàn.

- Dịch vụ từ xa: Các hệ thống hoặc dịch vụ trực tuyến mà MCP Server có thể kết nối và tận dụng.

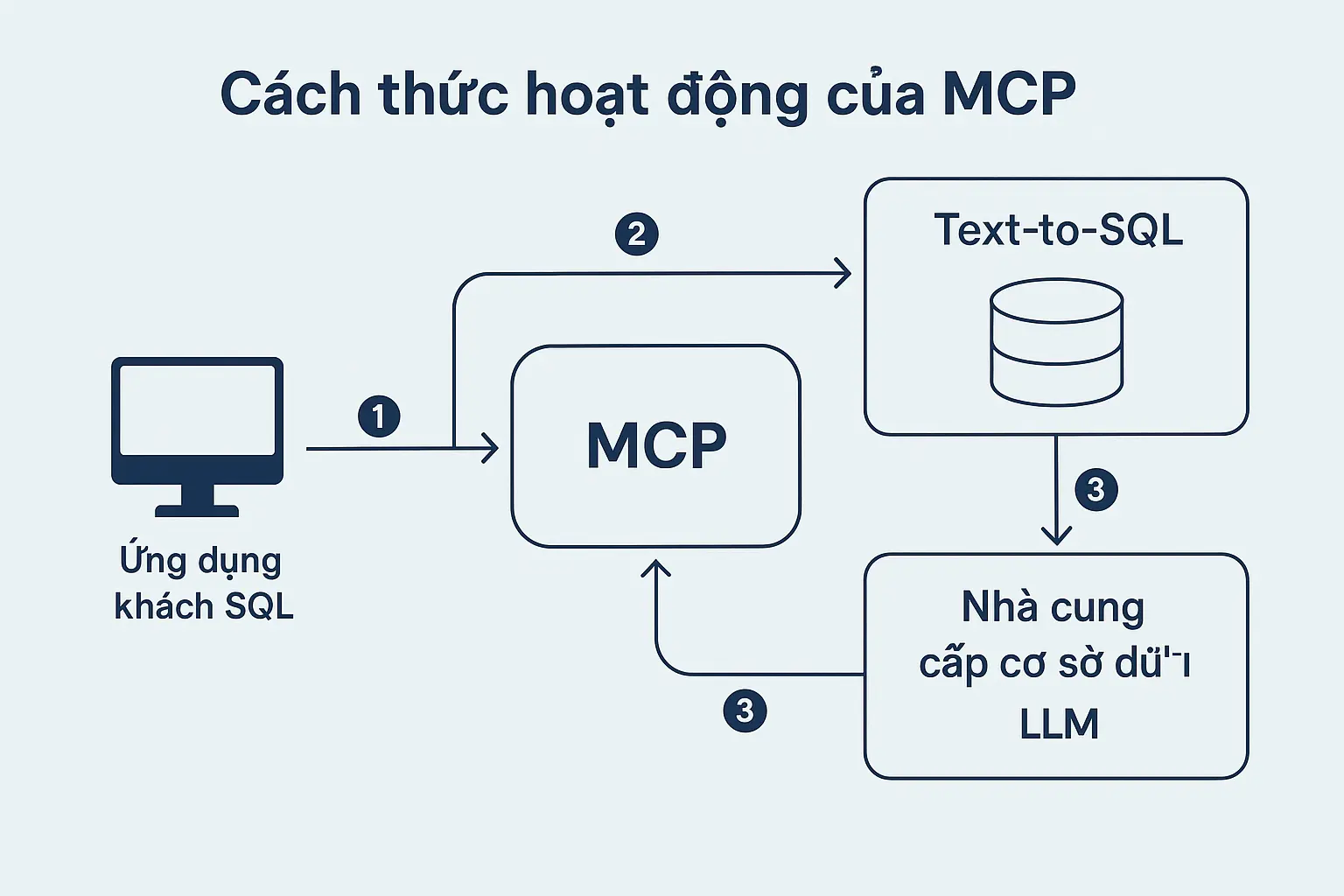

Cách thức hoạt động của MCP

Để hiểu rõ hơn về cách MCP hoạt động, hãy xem xét một ví dụ điển hình: Text-to-SQL – công cụ dịch ngôn ngữ tự nhiên sang ngôn ngữ truy vấn SQL.

Trước khi có MCP, quy trình thường diễn ra như sau:

- Ứng dụng khách SQL lấy schema từ cơ sở dữ liệu mục tiêu

- Ứng dụng gửi cho LLM một prompt chứa schema

- LLM trả lời với mã SQL

- Ứng dụng khách SQL thực thi mã SQL đối với cơ sở dữ liệu mục tiêu

Vấn đề là mỗi ứng dụng khách SQL cần phải triển khai quy trình này cho từng loại cơ sở dữ liệu được hỗ trợ, tạo ra một bài toán phức tạp M×N (M ứng dụng × N cơ sở dữ liệu).

Với MCP, quy trình được đơn giản hóa:

- Ứng dụng khách SQL chỉ cần triển khai giao thức khách MCP một lần

- Mỗi nhà cung cấp cơ sở dữ liệu chỉ cần triển khai máy chủ MCP một lần

- MCP đóng vai trò là lớp trung gian, biến bài toán M×N thành M+N

Lợi ích của MCP trong hệ sinh thái AI

Việc áp dụng giao thức MCP mang lại nhiều lợi ích đáng kể cho cả nhà phát triển và người dùng cuối:

Đối với nhà phát triển

- Giảm thời gian phát triển: Không cần tạo các tích hợp tùy chỉnh cho mỗi sự kết hợp giữa ứng dụng AI và nguồn dữ liệu

- Tiêu chuẩn hóa: Cung cấp một giao thức “cắm là chạy” chung cho mọi ứng dụng

- Mở rộng dễ dàng: Thêm nguồn dữ liệu mới mà không cần viết lại toàn bộ ứng dụng

Đối với người dùng cuối

- Trải nghiệm liền mạch: Các ứng dụng AI có thể truy cập nhiều nguồn dữ liệu khác nhau một cách dễ dàng

- Phản hồi chính xác hơn: AI có thể truy cập dữ liệu cập nhật và phù hợp với ngữ cảnh

- Bảo mật tốt hơn: Dữ liệu được xử lý cục bộ thay vì gửi đến các máy chủ từ xa

Ứng dụng thực tế của MCP

MCP đang được áp dụng trong nhiều lĩnh vực khác nhau, từ công cụ phát triển phần mềm đến trợ lý AI cá nhân:

Trong phát triển phần mềm

Các IDE tích hợp AI như Cursor có thể sử dụng MCP để kết nối với các hệ thống quản lý mã nguồn như GitHub, giúp AI hiểu rõ hơn về codebase và đưa ra gợi ý chính xác hơn. Ví dụ, khi một lập trình viên cần triển khai một tính năng mới, MCP có thể giúp AI truy cập các ticket hiện tại, tài liệu thiết kế và mã nguồn liên quan để đưa ra hướng dẫn phù hợp.

Trong trợ lý AI cá nhân

Các ứng dụng như Claude Desktop có thể sử dụng MCP để kết nối với các nguồn dữ liệu cá nhân như Google Drive, Obsidian, hoặc các ứng dụng ghi chú, giúp trợ lý AI đưa ra phản hồi dựa trên dữ liệu cá nhân của người dùng mà không cần chia sẻ dữ liệu với bên thứ ba.

Trong doanh nghiệp

Các công ty có thể sử dụng MCP để kết nối hệ thống AI với cơ sở dữ liệu nội bộ, hệ thống CRM, hoặc các công cụ quản lý dự án, tạo ra các trợ lý AI doanh nghiệp có khả năng truy cập thông tin nội bộ một cách an toàn và hiệu quả.

So sánh MCP với các giải pháp khác

Để hiểu rõ hơn về vị trí của MCP trong hệ sinh thái AI, hãy so sánh nó với một số giải pháp tương tự:

| Tính năng | MCP | Function Calling | LangChain |

|---|---|---|---|

| Vị trí xử lý | Phía client | Phía server | Phía client |

| Tiêu chuẩn hóa | Cao (giao thức chuẩn) | Trung bình | Thấp (nhiều cách triển khai) |

| Khả năng mở rộng | Cao | Trung bình | Cao |

| Bảo mật dữ liệu | Cao (xử lý cục bộ) | Thấp (gửi đến server) | Trung bình |

Điểm khác biệt chính giữa MCP và Function Calling là vị trí xử lý: MCP xảy ra ở phía client, trong khi Function Calling xảy ra ở phía server. Điều này có ý nghĩa quan trọng đối với bảo mật dữ liệu và khả năng tùy chỉnh.

Thách thức và hạn chế của MCP

Mặc dù MCP mang lại nhiều lợi ích, nhưng nó cũng đối mặt với một số thách thức:

- Đường cong học tập: Nhà phát triển cần thời gian để làm quen với giao thức mới

- Hiệu suất: Thêm một lớp trung gian có thể ảnh hưởng đến hiệu suất trong một số trường hợp

- Hệ sinh thái chưa hoàn thiện: Vì là công nghệ mới nên số lượng máy chủ MCP có sẵn còn hạn chế

- Vấn đề bảo mật: Cần đảm bảo các máy chủ MCP không truy cập dữ liệu trái phép

Hướng dẫn thiết lập MCP Server

Nếu bạn muốn tạo MCP Server của riêng mình, dưới đây là hướng dẫn cơ bản sử dụng TypeScript và Cloudflare Workers:

Bước 1: Cài đặt công cụ cần thiết

npm install -g wrangler

npm init mcp-server my-mcp-server

cd my-mcp-server Bước 2: Cấu hình MCP Server

// src/index.ts

import { createServer } from '@anthropic-ai/mcp';

export default {

async fetch(request: Request): Promise {

const server = createServer({

capabilities: {

search: {

async search(query: string) {

// Triển khai logic tìm kiếm của bạn

return {

results: [],

};

},

},

},

});

return server.handle(request);

},

};

Bước 3: Triển khai MCP Server

wrangler publish Sau khi triển khai, bạn có thể kết nối MCP Server của mình với các ứng dụng hỗ trợ MCP như Claude Desktop.

Tương lai của MCP

Giao thức MCP đang trong giai đoạn phát triển ban đầu nhưng có tiềm năng to lớn trong việc định hình tương lai của hệ sinh thái AI. Một số xu hướng phát triển có thể bao gồm:

- Mở rộng hệ sinh thái: Ngày càng nhiều nhà phát triển và công ty tham gia xây dựng máy chủ MCP cho các nguồn dữ liệu khác nhau

- Tích hợp sâu hơn: Các hệ điều hành và ứng dụng có thể tích hợp sẵn hỗ trợ MCP

- Tiêu chuẩn hóa: MCP có thể trở thành tiêu chuẩn công nghiệp cho việc kết nối AI với dữ liệu

- Cải thiện bảo mật: Phát triển các cơ chế bảo mật mạnh mẽ hơn cho giao thức

Kết luận

Model Context Protocol (MCP) đại diện cho một bước tiến quan trọng trong việc kết nối các hệ thống AI với thế giới dữ liệu. Bằng cách cung cấp một giao thức chuẩn hóa, MCP giúp giảm độ phức tạp trong việc tích hợp AI với các nguồn dữ liệu, đồng thời nâng cao khả năng của AI trong việc đưa ra phản hồi chính xác và phù hợp với ngữ cảnh.

Mặc dù còn đang trong giai đoạn đầu phát triển, MCP đã cho thấy tiềm năng to lớn trong việc định hình tương lai của hệ sinh thái AI. Với sự tham gia của cộng đồng phát triển và các công ty công nghệ, MCP có thể trở thành nền tảng cho một thế hệ ứng dụng AI mới – thông minh hơn, hiểu ngữ cảnh tốt hơn và tích hợp sâu hơn với dữ liệu của chúng ta.

Bạn đã sẵn sàng khám phá tiềm năng của MCP trong dự án AI tiếp theo của mình chưa?

Comments (1)

Giới thiệu N8N và Hướng dẫn Cài đặt Chi tiết (Docker, NPM) - Tự động hóa Workflow 2025says:

23/04/2025 at 12:59 AM[…] Khả năng kết hợp sức mạnh tự động hóa quy trình của n8n với trí thông minh của AI mở ra một kỷ nguyên mới về hiệu quả và năng suất làm việc. Hiện tại phiên bản mới đã hỗ trợ MCP, nâng khả năng tự động hóa lên một cấp bậc mới. Nếu các bạn chưa biết MCP là gì và muốn tìm hiểu về MCP thì có thể tham khảo bài viết Giao thức MCP (Model Context Protocol): Cách mạng kết nối trong hệ sinh thái AI […]